RNN循环神经网络 基础

1. 序列模型的应用

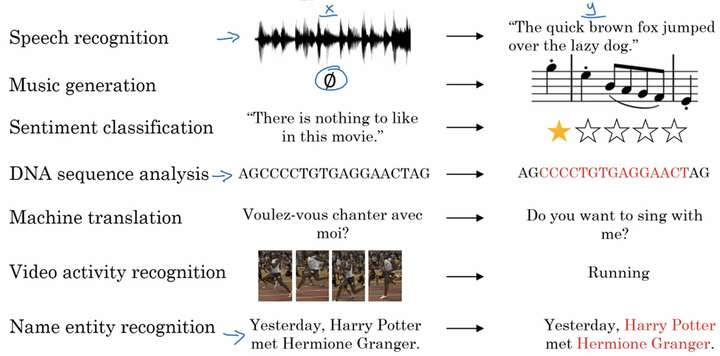

- 语音识别:将输入的语音信号直接输出相应的语音文本信息。无论是语音信号还是文本信息均是序列数据。

- 音乐生成:生成音乐乐谱。只有输出的音乐乐谱是序列数据,输入可以是空或者一个整数。

- 情感分类:将输入的评论句子转换为相应的等级或评分。输入是一个序列,输出则是一个单独的类别。

- DNA序列分析:找到输入的DNA序列的蛋白质表达的子序列。

- 机器翻译:两种不同语言之间的想换转换。输入和输出均为序列数据。

- 视频行为识别:识别输入的视频帧序列中的人物行为。

- 命名实体识别:从输入的句子中识别实体的名字。

2. 数学符号

- 输入

:如“Harry Potter and Herminone Granger invented a new spell.”(以序列作为一个输入),  表示输入  中的第  个符号。 - 输出

:如“1 1 0 1 1 0 0 0 0”(人名定位),同样,用  表示输出  中的第 个符号。 用来表示输入

的长度;

用来表示输出

的长度;

-  表示第  个输入样本的第  个符号,其余同理。 - 利用单词字典编码来表示每一个输入的符号:如one-hot编码等,实现输入

和输出

之间的映射关系。

3. 循环神经网络模型

传统标准的神经网络:

对于学习 和

的映射,我们可以很直接的想到一种方法就是使用传统的标准神经网络。也许我们可以将输入的序列X以某种方式进行字典编码以后,如one-hot编码,输入到一个多层的深度神经网络中,最后得到对应的输出

。如下图所示:

但是,结果表明这种方法并不好,主要是存在下面两个问题:

- 输入和输出数据在不同的例子中可以有不同的长度;

- 这种朴素的神经网络结果并不能共享从文本不同位置所学习到的特征。(如卷积神经网络中学到的特征的快速地推广到图片其他位置)

循环神经网络:

循环神经网络作为一种新型的网络结构,在处理序列数据问题上则不存在上面的两个缺点。在每一个时间步中,循环神经网络会传递一个激活值到下一个时间步中,用于下一时间步的计算。如下图所示:

这里需要注意在零时刻,我们需要编造一个激活值,通常输入一个零向量,有的研究人员会使用随机的方法对该初始激活向量进行初始化。同时,上图中右边的循环神经网络的绘制结构与左边是等价的。

循环神经网络是从左到右扫描数据的,同时共享每个时间步的参数。

管理从输入_到隐藏层的连接,每个时间步都使用相同的_ ,同下; 管理激活值  到隐藏层的连接; 管理隐藏层到激活值  的连接。

上述循环神经网络结构的缺点:每个预测输出

- 构造初始激活向量:

;

;通常选择

作为激活函数,有时也会使用

作为激活函数;(使用

函数梯度消失的问题会用其他方式解决)

;如果是二分类问题,使用

作为激活函数,如果是多分类问题,可以使用

激活函数;

- 注:其中

中,前面的

表示要得到一个

类型的量,

表示参数

要乘以一个

类型的量,其余

、

同理;

_是100维,__是10000维,那么_ 便是  维的矩阵, _便是__维的矩阵。堆叠起来,_ 便是  维的矩阵。 - ![[a^{

},x^{ }] = \left[ \begin{array}{l} {a^{ < t - 1 > }}\\\ {x^{ < t > }} \end{array} \right]](http://www.zhihu.com/equation?tex=%5Ba%5E%7B%3Ct-1%3E%7D%2Cx%5E%7B%3Ct%3E%7D%5D+%3D+%5Cleft%5B+%5Cbegin%7Barray%7D%7Bl%7D+%7Ba%5E%7B+%3C+t+-+1+%3E+%7D%7D%5C%5C%5C+%7Bx%5E%7B+%3C+t+%3E+%7D%7D+%5Cend%7Barray%7D+%5Cright%5D) ,表示一个  维的矩阵。

4. 穿越时间的反向传播

为了进行反向传播计算,使用梯度下降等方法来更新RNN的参数,我们需要定义一个损失函数,如下:

many-to-one:

如在情感分类问题中,我们要对某个序列进行正负判别或者打星操作。在这种情况下,就是输入是一个序列,但输出只有一个值:

one-to-many:

如在音乐生成的例子中,输入一个音乐的类型或者空值,直接生成一段音乐序列或者音符序列。在这种情况下,就是输入是一个值,但输出是一个序列:

many-to-many( ):

我们上面介绍的一种RNN的结构是输入和输出序列的长度是相同的,但是像机器翻译这种类似的应用来说,输入和输出都是序列,但长度却不相同,这是另外一种多对多的结构:

6. 语言模型和序列生成

在NLP中,构建语言模型是最基础也是最重要的工作之一,我们可以通过RNN来很好的实现。

什么是语言模型?

对于下面的例子,两句话有相似的发音,但是想表达的意义和正确性却不相同,如何让我们的构建的语音识别系统能够输出正确地给出想要的输出。也就是对于语言模型来说,从输入的句子中,评估各个句子中各个单词出现的可能性,进而给出整个句子出现的可能性。

使用RNN构建语言模型:

- 训练集:一个很大的语言文本语料库;

- Tokenize:将句子使用字典库标记化;

- 其中,未出现在字典库中的词使用“UNK”来表示;

- 第一步:使用零向量对输出进行预测,即预测第一个单词是某个单词的可能性;

- 第二步:通过前面的输入,逐步预测后面一个单词出现的概率;

- 训练网络:使用softmax损失函数计算损失,对网络进行参数更新,提升语言模型的准确率。

7. 新序列采样

在完成一个序列模型的训练之后,如果我们想要了解这个模型学到了什么,其中一种非正式的方法就是进行一次新序列采样(sample novel sequences)。对于一个序列模型,其模拟了任意特定单词序列的概率,如 ,而我们要做的就是对这个概率分布进行采样,来生成一个新的单词序列。

如下面的一个已经训练好的RNN结构,我们为了进行采样需要做的:

- 首先输入

,在这第一个时间步,我们得到所有可能的输出经过

层后可能的概率,根据这个

的分布,进行随机采样,获取第一个随机采样单词

;

- 然后继续下一个时间步,我们以刚刚采样得到的

作为下一个时间步的输入,进而

层会预测下一个输出

,依次类推;

- 如果字典中有结束的标志如:“EOS”,那么输出是该符号时则表示结束;若没有这种标志,则我们可以自行设置结束的时间步。

上面的模型是基于词汇的语言模型,我们还可以构建基于字符的语言模型,其中每个单词和符号则表示一个相应的输入或者输出:

但是基于字符的语言模型,一个主要的缺点就是我们最后会得到太多太长的输出序列,其对于捕捉句子前后依赖关系,也就是句子前部分如何影响后面部分,不如基于词汇的语言模型那样效果好;同时基于字符的语言模型训练代价比较高。所以目前的趋势和常见的均是基于词汇的语言模型。但随着计算机运算能力的增强,在一些特定的情况下,也会开始使用基于字符的语言模型。

8. RNN的梯度消失

RNN在NLP中具有很大的应用价值,但是其存在一个很大的缺陷,那就是梯度消失的问题。例如下面的例句中:

- The cat, which already ate ………..,was full;

- The cats, which already ate ………..,were full.

在这两个句子中,cat对应着was,cats对应着were,(中间存在很多很长省略的单词),句子中存在长期依赖(long-term dependencies),前面的单词对后面的单词有很重要的影响。但是我们目前所见到的基本的RNN模型,是不擅长捕获这种长期依赖关系的。

如下图所示,和基本的深度神经网络结构类似,输出y得到的梯度很难通过反向传播再传播回去,也就是很难对前面几层的权重产生影响,所以RNN也有同样的问题,也就是很难让网络记住前面的单词是单数或者复数,进而对后面的输出产生影响。

对于梯度消失问题,在RNN的结构中是我们首要关心的问题,也更难解决;虽然梯度爆炸在RNN中也会出现,但对于梯度爆炸问题,因为参数会指数级的梯度,会让我们的网络参数变得很大,得到很多的Nan或者数值溢出,所以梯度爆炸是很容易发现的,我们的解决方法就是用梯度修剪,也就是观察梯度向量,如果其大于某个阈值,则对其进行缩放,保证它不会太大。

9. GRU单元

门控循环单元(Gated Recurrent Unit, GRU)改变了RNN的隐藏层,使其能够更好地捕捉深层次连接,并改善了梯度消失的问题。

RNN 单元:

对于RNN的一个时间步的计算单元,在计算

简化的GRU 单元:

我们以时间步从左到右进行计算的时候,在GRU单元中,存在一个新的变量称为 ,(代表cell),作为“记忆细胞”,其提供了长期的记忆能力。

-  ,实际上记忆细胞输出的是在  时间步上的激活值  ; - ![\widetilde c^{

} = \tanh (W_{c}[c^{ }, x^{ }] + b_{c})](http://www.zhihu.com/equation?tex=%5Cwidetilde+c%5E%7B%3Ct%3E%7D+%3D+%5Ctanh+%28W_%7Bc%7D%5Bc%5E%7B%3Ct-1%3E%7D%2C+x%5E%7B%3Ct%3E%7D%5D+%2B+b_%7Bc%7D%29) ,在每一个时间步上,给定一个候选值  ,用以替代原本的记忆细胞  ; - ![{\Gamma u}=\sigma (W{u}[c^{

}, x^{ }] + b_{u})](http://www.zhihu.com/equation?tex=%7B%5CGamma+_u%7D%3D%5Csigma+%28W_%7Bu%7D%5Bc%5E%7B%3Ct-1%3E%7D%2C+x%5E%7B%3Ct%3E%7D%5D+%2B+b_%7Bu%7D%29) ,代x表更新门,是一个0-1的值,用以决定是否对当前时间步的记忆细胞用候选值更新替代; -  ,记忆细胞的更新规则,门控值处于0-1之间,根据跟新公式能够有效地**缓解梯度消失**的问题。 - 其中,  均具有相同的维度。

GRU的可视化实现如下图右边所示:

完整的GRU 单元:

完整的GRU单元还存在另外一个门,以决定每个时间步的候选值,公式如下:

其中,在实际使用时,几个门值不仅仅取决于

而双向RNN则可以解决单向RNN存在的弊端。在BRNN中,不仅有从左向右的前向连接层,还存在一个从右向左的反向连接层。

其中,预测输出的值